Resumo, Tese Central, Principais Insights e Recomendações Estratégicas

Resumo

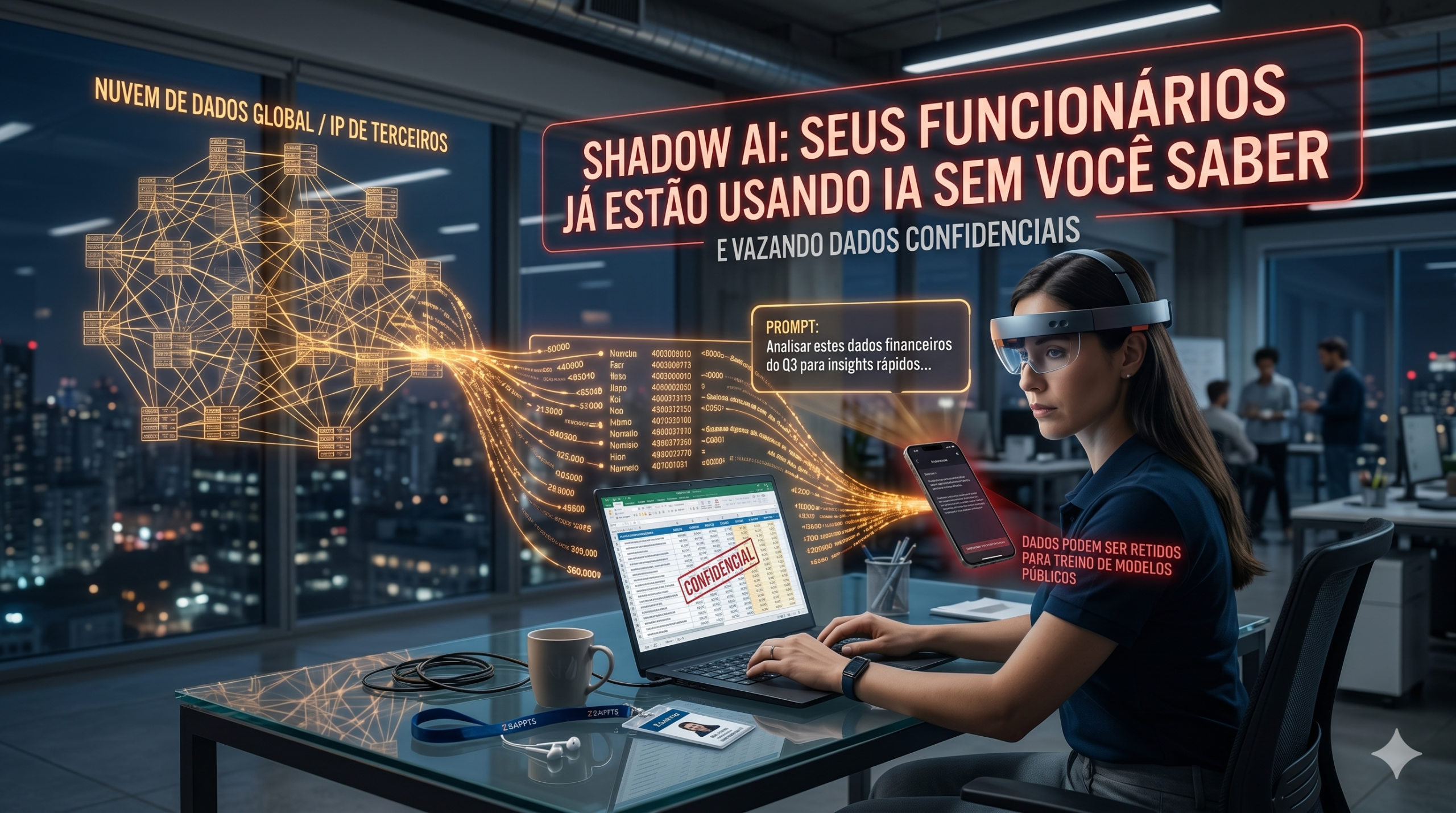

Enquanto conselhos diretivos debatem a “segurança da IA” em reuniões fechadas, a realidade no chão de fábrica é outra: colaboradores já adotaram ferramentas públicas massivamente para aumentar a produtividade, muitas vezes expondo dados confidenciais. Este artigo define o fenômeno do Shadow AI, explica por que políticas de bloqueio de firewall são ineficazes e propõe a criação de “Portos Seguros” de IA como única estratégia viável de mitigação.

Tese Central: O maior risco para a segurança da informação hoje não é a implementação de uma IA corporativa, mas a ausência dela. Ao não fornecer ferramentas oficiais e governadas, as empresas empurram seus funcionários para o uso clandestino de LLMs públicos (Shadow AI), onde a propriedade intelectual pode ser usada como dado de treino para modelos de terceiros*.

Principais Insights:

- – O Dilema da Produtividade: O funcionário não usa o ChatGPT para prejudicar a empresa; usa porque precisa entregar o relatório às 17h e a ferramenta oficial é lenta ou inexistente.

- – Bloqueio é Ilusão: Proibir o acesso ao OpenAI na rede corporativa apenas faz com que o funcionário use o 4G do celular pessoal, onde a empresa tem zero visibilidade.

- – Vazamento Invisível: Dados sensíveis (códigos-fonte, estratégias de M&A, dados de clientes) estão sendo colados em chats públicos, tornando-se parte do conhecimento do modelo global.

Recomendações Estratégicas:

- Substituir a política de “Proibição” pela política de “Substituição”: Oferecer um Chat Corporativo (Enterprise Instance) seguro e monitorado.

- Implementar filtros de DLP (Data Loss Prevention) específicos para prompts, detectando padrões de CPF ou cartões de crédito antes do envio para a API.

- Realizar campanhas de conscientização sobre como os LLMs públicos retêm dados.

Contexto e Problema de Negócio

Imagine o seguinte cenário: Um analista financeiro recebe uma planilha complexa com dados de faturação do último trimestre. O prazo é curto. Ele sabe que, se pedir à equipe de Dados, demorará 3 dias. Ele também sabe que, se colar esses dados no ChatGPT, terá a análise em 30 segundos. O que ele faz? Ele cola.

Nesse momento, os dados financeiros da sua empresa deixaram o perímetro de segurança e foram enviados para servidores públicos, onde podem ser retidos para treino futuro.

Isso é o Shadow AI. É a adoção descentralizada, invisível e não regulamentada de ferramentas de Inteligência Artificial por funcionários bem-intencionados. Segundo estudos de mercado e evidências do nosso estudo Panorama da IA no Brasil, a discrepância entre a “adoção oficial” (o que a TI aprovou) e a “adoção real” (o que as pessoas usam) é alarmante.

Drivers de Mercado: A Inevitabilidade do Uso

Por que o Shadow AI é tão prevalente?

- Acessibilidade Radical: Qualquer pessoa com um e-mail pessoal pode acessar os modelos de IA mais poderosos do mundo gratuitamente. A barreira de entrada é zero.

- Pressão por Eficiência: Em um mercado que exige “fazer mais com menos”, o funcionário vê a IA como a única bóia de salvação para não se afogar em tarefas.

- Lentidão da TI: Enquanto a TI leva 6 meses para aprovar uma ferramenta (POCs, RFPs, Compliance), o mercado muda. O funcionário não quer esperar.

Análise Estratégica: Do Avestruz ao Porto Seguro

Existem duas formas de lidar com o Shadow AI:

- – A Estratégia do Avestruz (Ineficaz): A empresa finge que não acontece ou tenta bloquear URLs no firewall.

- Resultado: O uso migra para dispositivos pessoais (ou BYOD – Bring your own device), tornando-se completamente inauditável. O risco aumenta.

- – A Estratégia do Porto Seguro (Recomendada pela Zappts): A empresa reconhece a demanda e oferece uma alternativa oficial.

- Ação: “Nós sabemos que você quer usar IA. Aqui está o Enterprise Chat, que usa o mesmo modelo “tal” que você gosta, mas roda em um ambiente privado onde seus dados não são usados para treino e nós temos logs de auditoria.” ou “Aqui está uma licença desse chat privado onde você está livre para utilizar nas suas tarefas diárias”.

Quando você oferece uma ferramenta melhor e mais segura que a pública, o Shadow AI desaparece naturalmente. Ninguém usa a ferramenta pirata se a oficial for boa.

Implicações para as Organizações

Ignorar o Shadow AI tem consequências jurídicas e estratégicas:

- – Violação da LGPD: Se um funcionário cola dados de clientes em uma IA pública que sofre uma violação de dados, a responsabilidade é da empresa controladora.

- – Perda de IP (Propriedade Intelectual): Códigos proprietários colados em assistentes de programação públicos podem aparecer como sugestão para desenvolvedores de empresas concorrentes no futuro.

Recomendações estratégicas

Para CTOs, CISOs e o DPOs:

- Lance um MVP de Chat Interno em 30 dias: Não tente construir a “IA perfeita” agora. Apenas disponibilize uma interface segura (tipo Azure OpenAI ou Amazon Bedrock) para tirar seus usuários do ChatGPT público. A Zappts pode te ajudar nesse desafio.

- Classifique seus Dados: Deixe claro o que pode e o que não pode ir para a IA. “Dados Públicos: OK. Dados Internos: OK no Chat Corporativo. Dados Confidenciais: Proibido.”

- Auditoria de Prompts: No ambiente corporativo, mantenha logs do que é perguntado. Isso não é para vigiar o funcionário, mas para identificar gargalos de processo e riscos de segurança (ex: alguém tentando desbloquear jailbreaks).

- Eduque, não apenas puna: Mostre aos times como os LLMs funcionam. A maioria das pessoas não sabe que o chat gratuito usa os dados delas*.

Conclusão

A segurança cibernética na era da IA não se faz com muros, mas com estradas pavimentadas. Se você não construir a estrada segura para a inovação, seus funcionários abrirão atalhos pela mata. E na mata, seus dados estão desprotegidos. Assuma o controlo do Shadow AI trazendo-o para a luz da governança.

Bônus: Como, legalmente, seus dados normalmente são tratados quando usamos os Chats de IA Público ou Privados.

Assim são tratados seus dados compartilhados nos Chats de IA: nas versões públicas (gratuitas ou planos individuais), o conteúdo das interações pode ser tratado como insumo para o aprimoramento da inteligência artificial, sendo incorporado aos bancos de dados de treinamento para futuras iterações dos modelos. Em contrapartida, nas versões privadas ou corporativas (planos Enterprise, Business e API), as plataformas oferecem garantias contratuais de privacidade, assegurando que as informações fornecidas permaneçam isoladas e jamais sejam utilizadas para treinar modelos globais ou compartilhadas com outros usuários, protegendo assim a propriedade intelectual e o sigilo de dados sensíveis.

Sobre o Autor

Rodrigo Bornholdt é Co-fundador e Chief Technology Officer da Zappts, especializado em Arquitetura de Software e Inteligência Artificial, com sólida experiência em liderança de times de tecnologia, desenvolvimento de sistemas complexos e inovação aplicada às estratégias de negócio.

Sobre a Zappts

Com 12 anos de atuação, a Zappts é uma empresa de tecnologia e inovação referência em Transformação Agêntica para grandes corporações. A empresa acumula mais de 280 projetos executados e 1 milhão de horas de engenharia para setores como finanças, saúde, varejo e energia. É a idealizadora do Panorama da IA no Brasil, pesquisa que mapeia a maturidade tecnológica nacional, e referência na implementação de agentes de IA integrados ao core business com foco em governança, ROI e eficiência operacional. Clique aqui para saber mais.