Resumo, Tese Central, Principais Insights e Recomendações Estratégicas

Resumo

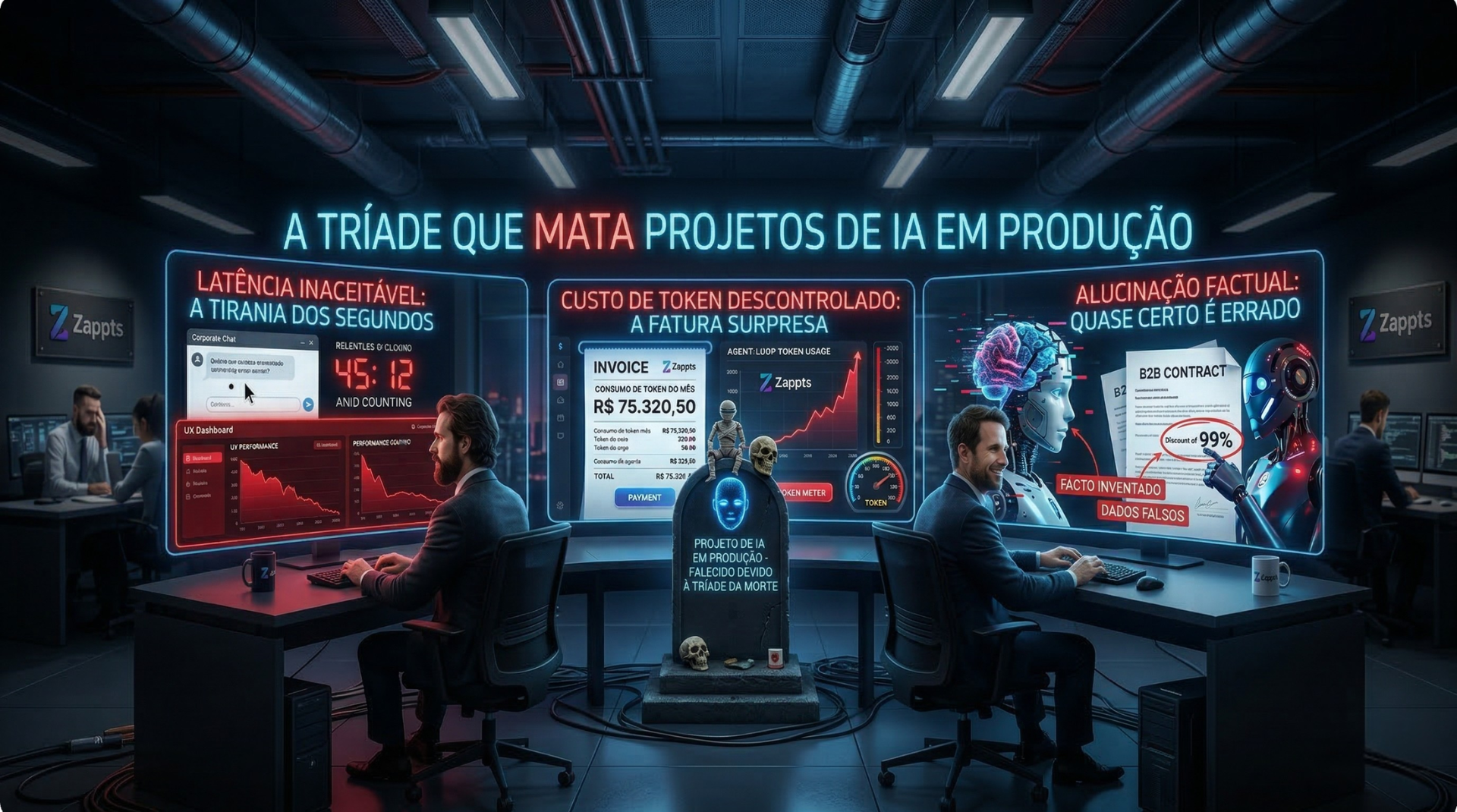

Muitas iniciativas de IA funcionam perfeitamente em ambiente de testes, mas colapsam na primeira semana de operação real. Este artigo disseca a “Tríade da Morte” — Latência inaceitável, Custo de token descontrolado e Alucinação factual — e apresenta estratégias de engenharia para mitigar esses riscos, transformando brinquedos experimentais em aplicações de missão crítica.

Tese Central: Colocar uma LLM em produção não é um desafio de Data Science, é um desafio de Engenharia de Sistemas Distribuídos. Sem uma arquitetura que contemple Cache Semântico, Roteamento de Modelos (Model Routing) e Guardrails Determinísticos, a experiência do usuário será lenta, o custo será proibitivo e a confiabilidade será nula.

Principais Insights:

- A Tirania dos Segundos: Usuários corporativos toleram esperar por um relatório complexo, mas não toleram esperar 15 segundos para uma resposta de chat. A latência (Time-to-First-Token) é o novo KPI de UX.

- A Fatura Surpresa: O modelo de cobrança por token transforma códigos mal otimizados em rombos financeiros. Um loop de agente mal desenhado pode consumir o orçamento do mês em horas.

- Precisão é Binária: Em B2B, “quase certo” é “errado”. O RAG (Retrieval-Augmented Generation) mal implementado aumenta a confiança da IA na mentira, em vez de corrigir o fato.

Recomendações Estratégicas:

- Implementar agentes especialistas que realizam tarefas padrões e menores ao invés de agentes generalistas que resolvem todo tipo e qualquer tamanho de problema.

- Implementar estratégias de Model Routing: usar modelos baratos e rápidos (ex: GPT-4.1-mini, Haiku) para tarefas simples e reservar os modelos caros (GPT-4.1,GPT-5, Opus) apenas para raciocínio complexo.

- Adotar Cache Semântico para evitar pagar duas vezes pela mesma pergunta frequente.

- Instituir Testes de Regressão em IA (Evals) automatizados antes de cada deploy.

Contexto e Problema de Negócio

No laboratório de inovação, com um único usuário testando, a IA parece mágica. O CEO faz uma pergunta, o cursor pisca, e 10 segundos depois, uma resposta brilhante aparece. O custo daquela interação? Irrisório, frações de centavos.

Então, o projeto vai para produção (Go-Live). De repente, 5.000 colaboradores acessam simultaneamente. A API da OpenAI engasga. O tempo de resposta sobe para 45 segundos. A fatura do cartão corporativo dispara porque os usuários estão colando documentos de 500 páginas para resumir. E pior: a IA começa a inventar descontos que não existem.

Esse cenário é o padrão da indústria hoje. Segundo dados do nosso estudo Panorama da IA no Brasil, 41% das empresas citam “Custos” como a barreira principal, muitas vezes descobertos tardiamente, para o uso da IA em suas empresas. A engenharia de software tradicional não preparou os times para lidar com sistemas não-determinísticos e caros.

Drivers de Mercado: A Física da IA em Escala

Três forças físicas atuam contra o sucesso da sua aplicação:

- Latência de Rede e Inferência: LLMs geram texto palavra por palavra. Quanto mais complexa a resposta, maior a espera. Em aplicações de atendimento ao cliente, cada segundo de atraso reduz a satisfação (CSAT) em 15% (Akamai).

- Economia de Tokens: Diferente de um servidor SQL onde você paga por capacidade fixa, na IA você paga por uso. Um prompt “preguiçoso” que envia todo o histórico da conversa a cada interação é financeiramente irresponsável.

- Natureza Probabilística: O software tradicional é lógico (Se A, então B). A IA é probabilística (Provavelmente B, mas talvez C). Em finanças e saúde, “talvez” é inaceitável.

Análise Estratégica: Engenharia de Defesa

Na Zappts, tratamos IA como sistemas de alta performance. Para combater a tríade, aplicamos técnicas específicas:

1. Combatendo a Latência (Otimização de UX): Não mostre apenas um “spinner” girando. Use Streaming Responses. Assim que a IA gera a primeira palavra, mostre-a ao usuário. Isso reduz a latência percebida de 10s para 0.5s. Além disso, use Cache Semântico: se alguém já perguntou “Como emito nota fiscal?” hoje, o sistema não deve chamar a IA de novo; deve entregar a resposta salva instantaneamente (Custo Zero, Latência Zero).

2. Combatendo o Custo (Model Routing): Nem toda pergunta exige um gênio. Se o usuário diz “Olá”, você não precisa do GPT-5 (que é caro). Um modelo menor resolve isso por 1% do preço. Prefira a construção de agentes especialistas ao invés de grandes agentes generalistas. Utilize “Roteadores de IA” que classificam a complexidade da pergunta e escolhem o modelo mais barato capaz de resolvê-la.

3. Combatendo a Alucinação (Grounding & Evals): A IA só deve responder com base nos documentos que você forneceu. Usamos técnicas avançadas de RAG (Retrieval-Augmented Generation) com citação obrigatória de fontes. Se a IA não encontra a resposta no documento oficial, ela é programada para dizer “Não sei”, em vez de inventar.

Implicações para as Organizações

Ignorar a engenharia por trás do prompt resulta em:

- Abandono da Ferramenta: Se a IA for mais lenta que pesquisar na Intranet, ninguém usa.

- Sangria de Opex: Projetos que começam custando R$ 5 mil/mês podem saltar para R$ 50 mil/mês sem aviso prévio se não houver monitoramento de tokens.

- Risco Legal: Uma alucinação em um contrato ou política de compliance pode invalidar processos jurídicos.

Recomendações para CTOs e Diretores de Engenharia

Para o Diretor de Engenharia e o CTO:

- Exija Métricas de Observabilidade: Você tem dashboards de CPU e Memória. Agora você precisa de dashboards de Latência por Token, Custo por Sessão e Taxa de Alucinação. O que não é medido, quebra a conta.

- Adote Small Language Models (SLMs): O futuro é rodar modelos pequenos e especializados e, eventualmente, dentro da sua própria infraestrutura (On-Premise ou Private Cloud), reduzindo drasticamente custos e latência de rede.

- Teste como Software, não como Magia: Crie pipelines de CI/CD para IA. Toda vez que você altera um prompt, um script deve rodar 100 perguntas de teste e verificar se a precisão caiu.

- Limite o Contexto: Não envie documentos inteiros se apenas um parágrafo é relevante. Otimizar o retrieval (busca) é mais barato do que pagar pelo processamento (geração).

Conclusão

Colocar IA em produção é fácil. Manter IA em produção com lucro e performance é difícil. A diferença entre uma POC fracassada e um Case de Sucesso geralmente não está na qualidade da ideia, mas na robustez da engenharia que a sustenta. Não deixe que a latência, o custo ou a alucinação mantenham sua inovação no berço.

No próximo artigo vamos explorar uma das técnicas vitais para o sucesso da implementação, a orquestração de pequenos agentes especializados.

Sobre o Autor

Rodrigo Bornholdt é Co-fundador e Chief Technology Officer da Zappts, especializado em Arquitetura de Software e Inteligência Artificial, com sólida experiência em liderança de times de tecnologia, desenvolvimento de sistemas complexos e inovação aplicada às estratégias de negócio.

Sobre a Zappts

A Zappts é a consultoria líder em transformação agêntica no Brasil, ajudando empresas a evoluírem do digital para o agêntico. Com mais de 10 anos a Zappts cria, moderniza e evolui soluções digitais seguras e escaláveis para grandes organizações. Combinando experiência prática em engenharia de software, dados e inteligência artificial, integra tecnologia, metodologia e processos acelerando a entrega de valor com eficiência, qualidade e governança. Sua atuação vai da estratégia ao desenvolvimento de aplicações de software e agentes de IA, sendo referência no Brasil no tema de agentes de inteligência artificial. Clique aqui para saber mais.